Камера с ии что это?

Искусственный интеллект, или AI-обработка в камерах смартфонов

Натолкнулся на мнение, которое оказалось достаточно широко распространенным: AI-алгоритмы в камерах смартфонов — это фильтры и ничего больше, они позволяют украсить ваши фотографии, но никакого смысла, кроме этого, не имеют. В какой-то мере такая точка зрения имеет право на существование, особенно если не хочется разбираться даже в самых простых вещах. Но давайте попробуем вспомнить, когда и как началась эпоха AI-камер в смартфонах и куда идет развитие рынка.

Очень часто я натыкаюсь на отсылку к камерам Sony, в которых автоматическое определение сцен появилось одним из первых, по аналогии с тем, что делают современные смартфоны, их считают прообразом AI-камер. Возможно, такое толкование было бы оправданным, если бы не одно возражение — AI-камера не может существовать без мощного процессора, который обрабатывает все изображения с нее, причем картинки как уже сделанные, так и те, что еще не сфотографированы. Первым производителем, сделавшим ставку на AI как будущее рынка не только камер, но устройств в целом, стала компания Huawei. В октябре 2017 года в Мюнхене компания показала свой флагман Mate 10/10 Pro. Это первый аппарат, для которого использовали словосочетание “встроенный AI”, упомянули, что он используется для фотографии, но выделять в отдельный термин не стали. Упор был сделан на чипсете Kirin 970, в нем впервые появился отдельный процессор для AI-вычислений, это особый вид задач и алгоритмов. Обычные процессоры могут выполнять такие алгоритмы, но они не оптимизированы для них, как результат, их производительность оставляет желать лучшего. Поэтому отдельный процессор, отвечающий за AI-вычисления, стал логичным развитием рынка чипсетов, и то, что в первую очередь он нашел применение для фотографии и встроенных камер, вполне логично.

Тогда на корпусе не писали, что аппарат обладает AI-алгоритмами, это стало популярно позднее, а волна таких моделей пришлась на 2019 год, когда AI-обработка снимков стала функцией по умолчанию во всех современных смартфонах. Например, на корпусе Huawei P Smart 2019 вы можете видеть надпись AI Camera, что в какой-то мере дань маркетингу и той популярности, что эта опция приобрела в глазах покупателей.

Как-то попытался узнать, как понимают AI-камеру обычные покупатели. Стоя в магазине в центре Москвы в качестве продавца, разговаривал с покупателями, спрашивал про эту функцию. Большинство ответов сводились к тому, что камера сама понимает, что перед ней, и улучшает фотографии соответствующим образом. Лица людей лишает изъянов, траву подкрашивает зеленым цветом, небо делает голубым. Рискну предположить, что большинство людей определяет AI в телефоне именно так и никак иначе. Фактически мы говорим о том, что камера телефона умеет понимать, что именно вы фотографируете, и менять настройки в зависимости от этого. Первоначально таких сценариев у Huawei было несколько десятков, но лиха беда начало. К выходу Huawei P20 Pro нейронные сети натренировали определять 19 категорий снимков, всего было около 500 сценариев. В Mate 20 Pro число категорий увеличилось до 25, а общее число сценариев превысило 1500. В данный момент их число еще больше, и оно постоянно растет.

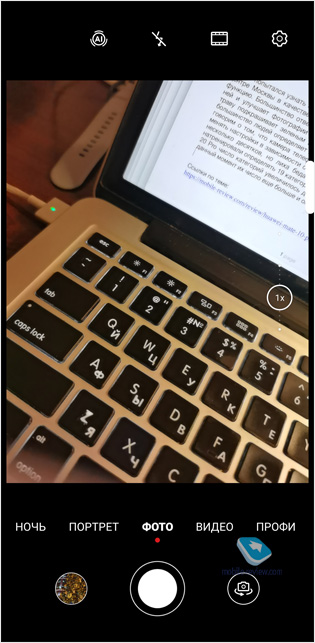

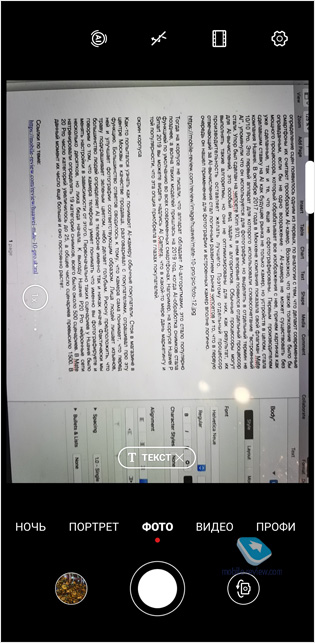

На практике в интерфейсе камеры есть “Мастер ИИ” (AI — это искусственный интеллект, ровно так же переводится аббревиатура), вы можете его как включить, так и выключить.

Когда мастер работает, то вы видите подсказку, например, наводите камеру на текст, и тут же появляется окошко, где говорится, что это текст.

Ровно так же все работает, когда вы наводите камеру на кошку или собаку, цветы и другие предметы, смартфон определяет, на что смотрит камера, и выставляет наилучшие параметры, чтобы ваш снимок для социальных сетей или для собственного использования был наилучшего качества. Кто-то говорит о том, что ратует за “натуральность”, но это настолько вымирающая тенденция, что тут просто нечего обсуждать, большая часть фотографий, которые вы видите в сети, имеют ту или иную редактуру, вольную или невольную. То, что большинство людей хочет навести камеру на предмет и получить качественный снимок, не вызывает сомнений. Меньшинство хочет некой натуральности, того, как предмет выглядит в их воображении. Но это скорее ностальгия по своим представлениям, не более того.

Вычислительная фотография пришла в нашу жизнь прочно и надолго. В темноте зачастую невозможно получить резкий, качественный снимок лица, чтобы были прорисованы отдельные волосы. А значит, можно взять примерно совпадающие волосы из базы телефона, добавить их к фотографии и получить снимок, который будет выглядеть принципиально иначе. Идея простая, но реализация на практике намного сложнее, чем это звучит. Тем не менее, это уже реализовано, и в Huawei даже пошли дальше.

На презентации Huawei P30 Pro нам показали сценарий Moon Shot, это снимок Луны. Телефон понимает, что вы направили его на Луну, использовали зум, и в этот момент делает “снимок”. Моему возмущению не было предела, так как я понимал, что оптика аппарата неспособна сделать такой снимок, и это выглядело как подделка. Спустя несколько месяцев я изменил свое мнение, и причина в том, что это ровно та же вычислительная фотография. Смартфон определяет предмет, который вы фотографируете, в нашем случае это Луна, а затем подставляет его из базы. Качественных снимков Луны много, выбрать есть из чего. Но никогда вы не могли сфотографировать Луну на свой смартфон. Тут же вам дали эту возможность, и она подкупает. Это не отражение реальности, если не считать таковым положение Луны на снимке, другие детали, например, окно или дерево, попавшее в кадр. Это скорее некая работа редактора, который подставляет качественное изображение объекта.

И вот этот пример отлично описывает то, куда движется вычислительная фотография, многие объекты не будут натуральными, их возьмут из уже существующих баз снимков, либо AI-алгоритмы дорисуют их так, как мы хотим их видеть. Самое время забыть о том, что когда-то существовала натуральность, отражение реального мира, фотография еще задолго до появления смартфонов стала манипулятивной, она не отражает реальный мир. Теперь эти манипуляции просто выходят на принципиально иной уровень, в какой-то мере становятся узаконенными. Первоначально это вызывает отторжение, стойкое неприятие. Но по зрелом размышлении ты начинаешь понимать, что весь мир будет устроен именно так и стоит это принять как можно раньше, чтобы не переживать о своих иллюзиях позднее. Прическа вашей девушки на снимке, текстура кожи и другие детали — все это отдаленное приближение к реальности, более того, сама реальность волнует немногих. Тут скорее вопрос в том, как сохранить грань между красотой снимка и искажением первоначальной картинки, как найти правильный баланс. Именно AI-алгоритмы будут их искать.

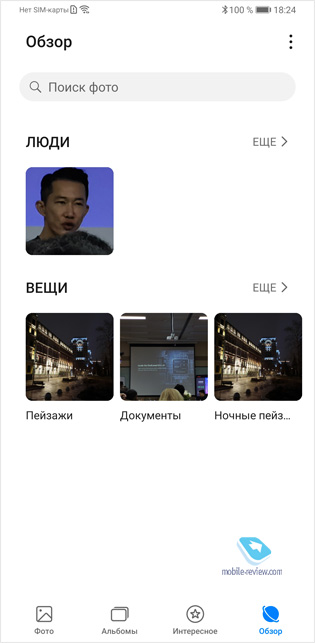

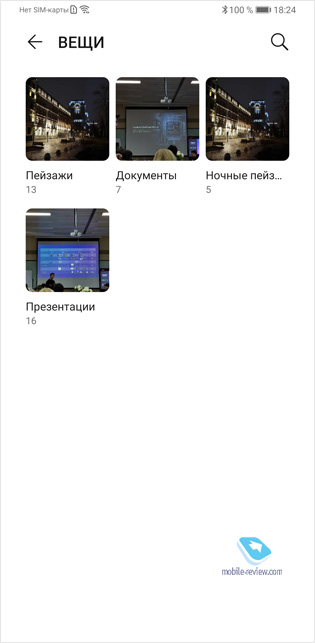

Теперь давайте посмотрим на уже готовые снимки, тут также задействуют AI-алгоритмы, в галерее можно увидеть, как снимки автоматически распределены по папкам, — смартфон понимает, где какая категория, и с каждым годом учится делать фото все лучше и лучше.

В той же Huawei специально создают AI-чип для своих процессоров, с каждым годом их производительность растет и остается одной из самых высоких. Причина в том, что именно такие алгоритмы становятся важны и постепенно выходят за рамки только камер и получения снимков. Сделанные снимки нужно распознать, AI-алгоритм определяет, есть ли на снимке люди, кто это и что они делают (радость, печаль, веселье и так далее — это определение эмоций), вещи и предметы, цвета и многое другое. Это кажется детской задачей, но она открывает целый спектр новых возможностей. Например, камера вашего телефона может научиться определять жесты и соответствующим образом реагировать. В том же Mate 30 Pro есть распознавание жестов, вы можете сделать скриншот, сжав кулак над экраном.

В какой-то мере AI — это познание внешнего мира, причем большая часть алгоритмов полностью автономна, она не требует сетевого соединения. И говорить о том, что AI — это только камера, невозможно, следует рассматривать камеру как внешний сенсор, который дает информацию для смартфона и тех алгоритмов, что в него вшиты. Мы только в самом начале пути, так как в будущем алгоритмы станут сложнее, замысловатее и при этом предложат совсем другой уровень персонализации.

Я не ставил задачей в небольшом материале остановиться на всех AI-алгоритмах, специфике их работы, это скорее статья для того, чтобы вы могли оценить направление развития, получить обзор того, куда идет индустрия.

Как искусственный интеллект меняет фотографию

Если вас заботит вопрос о том, насколько будет хороша камера вашего следующего смартфона, то стоит обратить внимание на то, что производитель говорит о наличии искусственного интеллекта (ИИ). Если отбросить шумиху и чистый маркетинг, то нет смысла отрицать, что эта технология подняла прогресс фотографии на новый уровень за последние несколько лет и нет никаких сомнений полагать, что темп прогресса замедлятся.

Аппаратное обеспечение тоже не стоит на месте, но самые впечатляющие достижения в области фотографии за последнее время случились на программном уровне, и это во многом благодаря ИИ, который даёт понять объективам куда их навёл пользователь.

Сервис Google Фото продемонстрировал, как искусственный интеллект умеет взаимодействовать с огромными массивами снимков. До его запуска Google использовала машинное обучение для категоризации изображений в Google+, эти навыки перекочевали в Google Фото. ИИ привел в порядок миллиарды неорганизованных пользовательских библиотек в порядок.

Искусственный интеллект Google Фото основывался на предыдущей разработки компании DNNresearch, которую поисковый гигант приобрел в 2013 году. Компания создала нейронную сеть с контролируемым обучением, она могла находить визуальные подсказки на уровне пикселей, чтобы идентифицировать категорию. Со временем алгоритм научился правильно распознавать изображения с помощью шаблонов, например, по снимку панды он обучился правильно идентифицировать другие фотографии панд. Он определяет, где черный мех, а где белый, а также пропорции животного. Используя эту информацию ИИ отличает панд от коров голштинской породы. Все эти «знания» классифицируются и заносятся в базу данных, они используются для поиска снимков по абстрактным терминам, таким, как «животное» или «завтрак».

Подобный алгоритм требует много времени и вычислительной мощности, поэтому вся работа выполняется на серверах компании после того, как снимок загружается в облако. Как только фотографии попадают в центр обработки данных (ЦОД) Google начинает использование алгоритма для анализа и маркировки. Примерно через год после запуска сервиса Google Фото компания Apple анонсировала функцию поиска фотографий, которая аналогичным образом задействовала нейронные сети, но в рамках обязательств компании по обеспечению конфиденциальности категоризация выполняется процессором устройства без отправки данных на сервера. Обычно этот процесс занимает несколько дней и происходит в фоновом режиме.

Искусственный интеллект и машинное обучение, помимо управления фотографиями, также оказывают большое влияние на процесс создания снимка. Количество объективов на спинках смартфонов растет как грибы, а матрицы увеличиваются в размерах, но физику не обманешь — прогресс ограничивает толщина корпуса мобильных устройств. Несмотря на это, современные смартфоны нередко делают более качественные снимки, чем некоторые камеры. Всё потому, что обычные камеры не в состоянии конкурировать с аппаратным обеспечением смартфонов, которое также важно для фотографии — центральный процессор (ЦП), процессор обработки сигналов изображения и блок ИИ, если такой предусмотрен производителем.

Эти компоненты используются в «вычислительной» фотографии, под этот термин попадают такие явления современного мобильного фото, как эффект глубины резкости портретных режимов и алгоритмы, позволяющие создавать качественные изображения в смартфонах Pixel. Apple использует эту технологию для управления портретным режимом в смартфонах с двумя камерами. Процессор обработки изображений iPhone идентифицирует в кадре человека с помощью одной камеры, а вторая камера создает карту глубины резкости, чтобы отделить объект и размыть фон.

Google остается очевидным лидером в области «вычислительной фотографии» и превосходные результаты камер всех трех поколений Pixel тому доказательство. Режим HDR+ использует сложный алгоритм, объединяющий несколько снимков с разным уровнем экспозиции в одну фотографию. Наличие машинного обучения означает, что система продолжает улучшаться со временем. Google обучил свой искусственный интеллект огромному набору данных с помощью сервиса Google Фото и эти знания помогают камере Pixel в подборе правильной экспозиции.

Говоря о преимуществе смартфонов Google стоит упомянуть режим Night Sight, который с помощью длинных выдержек и алгоритма машинного обучения показывает впечатляющие результаты на съемках в условиях плохого освещения. Эта функция наилучшим образом реализована в Pixel 3, потому что алгоритмы разрабатывались с учетом аппаратного обеспечения этого устройства. Несмотря на это, Google сделала режим Night Sight доступным для всего модельного ряда смартфонов Pixel, даже для самых первых, в которых отсутствует оптическая стабилизация. Это решение доказывает, что программное обеспечение выходит на первый план, когда дело доходит до мобильной фотографии.

Тем не менее, аппаратная составляющая все еще имеет значение, особенно в случаях, когда она умеет взаимодействовать с искусственным интеллектом. Отдельные процессоры обработки изображения были очень важны для качества мобильной фотографии, но похоже, что чипы с ИИ будут играть более важную роль в развитии цифровой фотографии. Huawei была первой компанией, представившей систему на кристалле (SoC) с искусственным интеллектом — Kirin 970, хотя Apple Bionic A11 в конечном итоге первым добрался до пользователей. Крупнейший поставщик процессоров Qualcomm не уделяет особого внимания машинному обучению. Google разработала свой собственный чип под названием Pixel Visual Core, который помогает решать задачи связанные с ИИ. Последняя версия Apple A12 Bionic оснащена восьмиядерным нейронным движком, который может выполнять задачи в среде машинного обучения Apple до 9 раз быстрее, чем A11. Apple сообщает, что это дает камере лучшее понимание фокальной плоскости, а это помогает создавать более реалистичную глубину резкости.

Эта технология важнее для эффективного и производительного машинного обучения прямо на устройстве. Google продемонстрировала впечатляющую работу, которая снижает нагрузку на обработку с ghvhom. ЦОД, в то же время нейронные движки (Neural Engine) становятся быстрее с каждым годом. На раннем этапе развития «вычислительной» фотографии у камер смартфонов, которые разрабатывались для работы в тандеме с машинным обучением, есть реальные преимущества. Из всех возможностей искусственного интеллекта, фотография — наиболее практичная область применения. Камера — неотъемлемая часть любого смартфона, а ИИ — отличный способ её улучшить.

Что такое AI камера на смартфоне Xiaomi

AI камера – режим съемки, когда для определения сцены и обработки снимков в смартфоне задействуют отдельный NPU-процессор, который отвечает за искусственный интеллект. Это делает кадры насыщеннее путем наложения фильтров, применяя заранее заготовленные надстройки.

Как работает AI камера в смартфонах Xiaomi

В телефонах от Xiaomi полноценная поддержка Al камеры появилась с обновлением до прошивки MIUI 10. На смартфонах без выделенного NPU-чипа она позволила использовать эффект боке (размытие фона вокруг объекта) для снимков на фронтальную и основную камеры без помощи второго объектива.

На девайсах помощнее значок функции появился в главном меню стандартной камеры. По умолчанию он находится сверху и обозначен как «AI». При наведении сенсора на человека, животных или объекты иконка меняется на соответствующую:

- деревья, цветы, трава – изображение листка;

- коты, собаки, грызуны – пушистая мордочка;

- небо, горизонт – облако.

Это значит, что, распознав сцену снимка, устройство подбирает один из ранее заготовленных фильтров и автоматически меняет настройки камеры. Полученный результат напрямую зависит:

- от процессора, установленного в смартфоне. Снимок, сделанный на Redmi Note 7 со Snapdragon 660, будет хуже, чем на Mi9 со Snapdragon 855. Дело в разной архитектуре и производительности однокристальных систем;

- от использованного софта. Установленный в девайс процессор взаимодействует с написанным под него программным обеспечением. Если алгоритмы несовершенны, снимки получаются среднего качества. Поэтому апдейты системы или загрузка стороннего софта (Google-камеры) влияют на конечное качество снимков;

- от объектива основной и дополнительных камер. Процессор и ПО напрямую взаимодействуют с установленными в устройства сенсорами. Последние отличаются разрешением, светочувствительностью, размером объектива, пикселя, поддержкой технологий вроде Dual Pixel и прочего.

В дорогие смартфоны устанавливают оптику от именитых брендов типа Zeiss.

Алгоритмы искусственного интеллекта постоянно совершенствуются, увеличивая количество сцен и объектов, которые смартфон способен распознать.

История развития AI в смартфонах

До появления выделенного процессора искусственный интеллект в смартфонах использовали для распознавания в объективе людей, лиц или улыбок. Внедрение NPU началось в 2017-м, после презентации компанией ARM микроархитектуры Dynamiq, увеличивающей скорость работы с ИИ.

Одними из первых нейропроцессор использовали Huawei в фирменной однокристальной системе Kirin 970. Это позволило:

- увеличить скорость решения задач, уменьшив энергопотребление устройства;

- использовать технологию распознавания лиц для разблокировки девайса. Особенно в сочетании с 3D-модулем камеры, способным распознать выражение владельца при минимальном освещении. Наличие машинного обучения позволяет различить владельца, примерь он очки, измени прическу или навяжи шарф;

- распознавать речь. Влияет на точность определения голоса и фраз голосовым помощником или онлайн-переводчиком;

- оптимизировать рабочие процессы. Телефон отмечает часто используемые приложения и добавляет их в оперативную память, чтобы увеличить скорость загрузки программ после запуска;

- работать с галереей. Умея отличать людей от животных, а облака от деревьев, мобильные аппараты научились создавать тематические папки. Это упростило возможность сортировать снимки;

- дополнительно стабилизировать. Кроме оптической и электронной, появилась интеллектуальная стабилизация фото и видео.

Смартфоны Сяоми работают на базе чипсетов от Snapdragon, которые отказались от отдельного блока NPU. Вместо этого AI в них реализован через вспомогательные процессоры вроде DSP, Hexagon и графического ядра. Такое решение в компании называют движком AI Engine, и оно проигрывает выделенному NPU в Kirin. К примеру, Kirin 9000 набирает в тесте АИ бенчмарка 148 баллов против 59,9 очка у Snapdragon 865 Plus – это составляет порядка 240 % разницы. Ближайшим конкурентом Кирин выступает среднебюджетный Dimensity 1000+ от MediaTek с результатом 92,3 балла.

Ситуация может измениться после официального запуска платформ Snapdragon 875 и Exynos 1080 по утечкам, получившим выделенный НПУ. А учитывая санкции в отношении Huawei, их Kirin 9000 станет последней фирменной платформой производителя.

Итоги

Наличие AI означает поддержку устройством алгоритмов искусственного интеллекта, призванного увеличить качество снимков, производительность и энергоэффективность девайса. Скорость работы ИИ зависит от наличия в однокристальной системе выделенного NPU и производительности в целом.

Для чего нужен ИИ в камерах наблюдения?

С каждым днем растет популярность систем видеонаблюдения и сетевых IP-видеокамер как среди домашних пользователей, так и в сегменте среднего и малого бизнеса (СМБ).

В последние годы особый интерес у покупателя вызывают камеры с дополнительными интеллектуальными функциями, которые значительно расширяют возможности обычных устройств этой категории. Попробуем разобраться, для чего может быть нужен ИИ в современных IP-камерах.

Любой сценарий видеонаблюдения приводит к накоплению значительного объема видеоданных, эффективное использование которых требует хотя бы минимального анализа. Нам нужно видеонаблюдение для того, чтобы понять, что происходило в определенном месте и в определенное время, а также для того, чтобы предотвратить нежелательные события. Если объемы данных достаточны, их также можно оценить на предмет статистических закономерностей. Извлекать пользу из подобной информации может как человек, так и компьютер. Если речь идет о работе пункта охраны некоего объекта, то там, скорее всего, предусмотрен гибридный подход. Оператор непосредственно наблюдает за происходящим в зонах видимости камер, а параллельно с этим ПО анализирует видеопоток, при необходимости формируя определенные сигналы для рассмотрения оператором.

В случае домашних сценариев оператором выступает сам владелец жилья, что осложняет ситуацию, потому что обычно ни у кого нет времени и возможностей для постоянного мониторинга ситуации. Да, существует удаленное подключение к камерам, однако с учетом занятости современного человека заниматься этим постоянно нереально. Зато можно реагировать на события, которые из общего видеопотока выделяет как раз ИИ. Когда мы говорим про ИИ применительно к данной сфере, не всегда подразумеваем полноценный искусственный интеллект, но для краткости и удобства имеет смысл использовать именно этот термин.

Несмотря на то что основным толчком к бурному развитию сферы видеонаблюдения послужил запрос со стороны коммерческих и госструктур, которым требовалось контролировать передвижение людских и транспортных потоков, сегодня IP-камеры и системы видеонаблюдения на их основе также массово используются в быту. Этому способствует значительное удешевление техники, происходящее в последние годы.

ИИ – наше всё?

Интеллектуальность видеокамер не ограничивается их аналитическими способностями. По большому счету, сюда также можно отнести предварительную обработку видеоизображения: удаление шумов, компенсацию вибраций и увеличение контрастности там, где необходимо. Однако этим сейчас никого не удивишь, и в большинстве устройств такие возможности активированы по умолчанию. Да и абсолютно естественно воспринимается тот факт, что IP-камера сжимает видеопоток с помощью современных видеокодеков, что позволяет обходиться меньшими по объему накопителями для хранения записей. Далее по списку следует обнаружение движения и классификация объектов в видеопотоке в соответствии с десятками, а то и сотнями различных критериев. А уже на базе этого строятся еще более сложные алгоритмы, например, распознавание автомобильных номеров, подсчет количества проходящих в кадре людей и даже определение эмоций на их лицах. Пусть вас не смущает перечисление живых и неживых объектов в одном списке — в конечном счете ИИ без разницы.

Современные IP-камеры уже давно не только записывают видеоряд, но и проводят его предварительный анализ с помощью встроенной электроники и ПО. Устройства могут реагировать на движение и иные изменения в кадре, отличать события в кадре, требующие реакции со стороны, от ложных триггеров. Благодаря широким возможностям анализа объектов в кадре, камеры могут распознавать их в соответствии с подключенными к системе базами данных, искать интересные для изучения типы объектов и отсекать неинтересные. Еще одна важная функция — активация записи видео в случае пересечения объектом заранее заданной линии в поле зрения камеры или превышения громкости звука выше определенных пределов (крики, выстрелы, звуки бьющегося стекла). Такая глубокая настройка позволяет записывать не все подряд, а только то, что действительно требует внимания. К слову, подобный подход к работе с IP-камерами может не только экономить место для хранения данных, но и сокращать время работы оператора.

В большинстве случаев интеллектуальная часть работы IP-видеокамер сводится к обнаружению и отслеживанию различных объектов в зоне наблюдения. Необходимо распознавать объекты, когда те появляются в заданной области, фиксировать время нахождения в ней и факт покидания объектов зоны наблюдения. Интерес для наблюдателя представляют не только динамические, но и статические объекты, в частности, их исчезновение из поля зрения камеры спустя какое-то время. Также во многих устройствах предусмотрена возможность вести объект по маршруту его передвижения, отображая соответствующую траекторию на видео. Помимо прочего, следить за объектами и выделять их из общего потока можно по их свойствам, например, по размерам или цветовому исполнению.

Проблемы

Можно ли обойтись без интеллектуальных функций при работе с системами видеонаблюдения? Да, , если в вашем распоряжении есть ресурсы для постоянного просмотра многочасовых записей. Но даже для коммерческих учреждений эта задача оказывается чрезмерно дорогой и требующей высочайшего уровня внимательности оператора. Автор хорошо помнит ситуацию десятилетней давности, когда возникла необходимость найти человека, который предположительно попал в поле зрения уличной камеры видеонаблюдения в диапазоне 6–8 часов. Возможности ИИ в той системе реализованы не были, а качество изображения оставляло желать лучшего. После часа просмотра видеозаписей стало понятно, что вручную сделать это очень сложно.

.jpeg)

Поэтому проблема номер один — объемы информации. Если в случае с коммерческим объектом все более или менее очевидно, то в рамках квартиры/дома складывается ложное впечатление, будто можно обойтись простой видеозаписью. В каких-то случаях это, безусловно, так. Допустим, если в квартире, где стоит одна простейшая IP-камера, произошла кража, достаточно посмотреть запись за определенный промежуток времени и обнаружить нужную информацию. Но и это сработает в том случае, если камера функционирует в режиме нон-стоп и не перезаписывает свое содержимое каждые 2 часа, как автомобильный видеорегистратор. Вот почему гораздо удобнее, если камера будет самостоятельно реагировать на события, например, на появление в зоне видимости движущихся объектов, и сообщать об этом с помощью соответствующих уведомлений на смартфон владельца жилья. Но это уже зона ответственности ИИ.

За анализ больших массивов данных сегодня отвечают нейронные сети, которые с помощью так называемого глубинного обучения постоянно улучшают свои навыки работы с информацией. Проанализировав сотни тысяч лиц из изначальной базы данных, в определенный момент нейронная сеть становится способной определять новые лица и добавлять их в базу. Именно такие технологии используются в крупных городских системах распознавания лиц. Но и они далеки от совершенства: ошибки неизбежны, хотя с каждым годом процент брака в работе ИИ сокращается. По некоторым данным, сегодня число ошибочных результатов составляет менее 1%. Общий принцип алгоритмов по распознаванию лиц заключается в анализе определенных биометрических паттернов, уникальных для каждого человека. В свою очередь, детальное описание особенностей алгоритмов, используемых в конкретных устройствах разных производителей, нередко является закрытой информацией, коммерческой тайной.

Следует понимать, что ИИ-функции требуют внушительных вычислительных мощностей. Однако сегодня развитие микроэлектроники достигло таких высот, что многие мобильные чипы, которыми оснащают IP-видеокамеры, способны выполнять существенную часть ИИ-операций, не отправляя их на удаленные серверы, а непосредственно на борту устройства. Это стало ключом к появлению на рынке более эффективных и бюджетных решений. В то же время производители, ведущие борьбу за адекватное соотношение возможностей устройства и его стоимости, подчас вынуждены выбирать между качеством съемки (чувствительностью) IP-камеры и различными интеллектуальными возможностями. Дело в том, что в современных цифровых камерах чувствительность устройства в значительной степени зависит от его вычислительных способностей. Поэтому многие бюджетные IP-камеры с ИИ на борту предназначены лишь для выполнения очень простых, стандартных задач. Серьезная видеоаналитика требует других подходов. К тому же разработка качественного интеллектуального ПО — дело весьма затратное, и не каждый вендор намерен серьезно вкладываться в это.

Еще одна немаловажная проблема — различные стандарты и протоколы. Каждый производитель по-своему видит развитие рынка и, соответственно, предлагает собственные решения и подходы. Это типичная проблема многих сегментов компьютерной и бытовой техники. В том же сегменте решений для «умного» дома проблема с зоопарком стандартов до сих пор не решена. Вот и производители IP-камер, каждый в меру своего понимания, реализуют различные частные сценарии использования интеллектуальных функций, при этом единого стандарта пока что никто не придерживается. Международная электротехническая комиссия (International Electrotechnical Commission, IEC) ведет работу в этом направлении, но она далека от завершения.

Несмотря на то что уровень ложных срабатываний систем видеонаблюдения значительно снизился по сравнению с тем, что было 5–10 лет назад, проблема полностью не исчезла. Любая современная IP-камера должна уметь учитывать изменения окружающей среды, в частности, дождь или снег, внезапные резкие движения в виде, например, падения ветки дерева. Все это способно привести к ошибочным сигналам тревоги. Чем дешевле и проще камера, тем больше вероятность ложных срабатываний.

Кстати, еще один вариант применения интеллектуальных способностей камеры — возможность устройства самостоятельно определять попытки извне ограничить его правильное функционирование, допустим, вскрыть, перекрыть обзор, расфокусировать изображение.

Выводы

«Умные» IP-камеры стремительно меняют нашу жизнь. Их устанавливают в подъездах, в общественном транспорте, на дорогах, во дворах и в жилых помещениях. С их помощью ловят преступников и выписывают штрафы. Да, в определенной степени можно говорить о том, что наше общество становится менее свободным, но этот процесс уже не остановить. Остается только надеяться, что широкие возможности будут использоваться в большей степени на благо общества, а не для усиления контроля.

Что касается применения камер с ИИ-функциями в быту, к выбору таких устройств нужно подходить ответственно, внимательно изучая набор предлагаемых функций и технические спецификации. Желательно разобраться в том, как именно будут реализовываться заявленные производителем возможности. Например, будут ли ваши данные отправляться для анализа на сторонние серверы или же их обработкой займутся исключительно сами устройства. Пользу от вовлеченности среднестатистического потребителя в изучение технических нюансов работы этих устройств не нужно недооценивать. Сегодня многие пользователи не раскрывают полностью потенциал устройств, с которыми работают, просто потому что они не знают об их возможностях.

Стоит ли искать IP-камеру именно с поддержкой функции распознавания лиц — вопрос открытый. Если речь идет о крупном коммерческом объекте, то да, вероятно, стоит. Это может пригодиться, например, чтобы организовать систему идентификации штатных сотрудников офиса или постоянных покупателей магазина. То есть подразумевается именно локальная система распознавания лиц и соответствующая ей база данных. Если же речь идет о квартире или частном доме, то особого смысла в установке такой системы нет. Идентифицировать человека, пришедшего извне впервые, такая система не сможет, ведь для этого ее нужно было бы подключить к существующей базе данных по реальным людям, что не представляется возможным, так как это прерогатива силовых структур и правоохранительных органов. Один из немногих сценариев, в рамках которого может потребоваться такая система дома, — организация доступа в жилое помещение с помощью настройки узнавания «умным» домом человека в соответствии со списком лиц, которым виртуальный дворецкий должен открывать двери. Однако на сегодня это все еще сценарий из будущего, хотя и не такого далекого, как может показаться. Также не стоит забывать, что IP-камеры с качественной реализацией алгоритмов распознавания лиц в основном представлены в высокобюджетном сегменте.

Напоследок напомню, что не менее актуальны вопросы безопасности, ведь любая камера, к которой можно подключиться через Сеть, сама становится потенциальным объектом для атаки со стороны злоумышленников. Согласитесь, никому не хотелось бы, чтобы онлайн-трансляция с видеокамеры из вашей квартиры оказалась доступной для случайных зевак или недоброжелателей извне. Но это уже тема для отдельного материала.

Искусственный интеллект и будущее фотографии

Вы можете этого не знать, но искусственный интеллект (ИИ) уже стал неотъемлемой частью жизни каждого. Он помогает делать…

Вы можете этого не знать, но искусственный интеллект (ИИ) уже стал неотъемлемой частью жизни каждого. Он помогает делать все быстрее, лучше и не тратить время на рутинные задачи. Чтобы у нас было больше времени на творчество, наши смартфоны оснащены ИИ-камерами, качество изображений выше, чем когда-либо, а программное обеспечение автоматизировано.

Вопрос, который остается открытым для многих фотографов: повлияет ли ИИ на их работу? Мы можем однозначно ответить, что да. О последствиях тесного взаимодействия технологий и фотографии мы расскажем в этой статье.

1. ИИ меняет главную идею фотографии

Идея фотографии была ясна еще с первых попыток сделать снимки в 19 веке: делиться с другими тем, что видишь. Как искусство светописи, позволяющее создавать долговечные изображения, фотография требовала определенных технических навыков. По крайней мере, так было до сих пор.

Развитие современных технологий ставит изначальную идею фотографии под сомнение. Это стало очевидным, когда Microsoft выпустила Drawing Bot, который генерирует изображения с помощью текста. При этом не нужно указывать много деталей. Словосочетаний “желтое тело, черные крылья и короткий клюв” достаточно, чтобы получить очертания птицы. В Microsoft говорят, что изображение, вероятно, будет содержать детали, которых не было в описании. Это показывает, что Drawing Bot обладает не только искусственным интеллектом, но и искусственным воображением.

Можно предположить, что эта технология будет очень кстати в работе дизайнеров, ведь благодаря короткому описанию они получат полную визуализацию дизайна интерьера. Изображения, которые создает Drawing Bot, выглядят настолько реалистично, что их можно легко спутать со снимками. То есть по сути эта технология меняет основы фотографии, ее понимание и определение. Теперь вам не нужен свет для создания изображений. Достаточно текста. Кто мог это предвидеть?

Еще одна передовая технология – Google Clips. Она позволяет посмотреть на фотографию по-новому. Если Drawing Bot не требует света для создания изображений, Google Clips в некотором смысле нивелирует роль фотографа.

Эта технология больше подойдет для начинающих фотографов, а также владельцев смартфонов. Она дает вам возможность присутствовать на всех фотографиях и без задержек фиксирует самые интересные моменты жизни. К тому же делает это сама, без вашего ведома.

Google Clips – маленькая камера, которая подключается к iPhone, Google Pixel или Samsung Galaxy S7 и S8 по Bluetooth и WiFi. Используя алгоритм распознавания людей от Google, она сканирует знакомые лица, а также все, что происходит вокруг, и автоматически фиксирует интересные сцены. Так что нет необходимости управлять камерой или выставлять таймер на смартфоне.

У Google Clips нет дисплея или интерфейса. Серии снимков, которые делает камера, вы можете найти на своем смартфоне. Таким образом, она ставит под сомнение необходимость того, чтобы человек управлял камерой и принимал решения относительно композиции.

Если 10 лет назад технические навыки и художественное видение были обязательными для профессионалов и любителей, сегодня даже младенец со смартфоном может сделать неплохой снимок. Достаточно взглянуть на последние достижения Apple.

ИИ-камера в iPhone 11 Pro позволяет снимать в сложных условиях и не тратить много усилий на поиски идеального ракурса. Как только вы нажмете кнопку, три камеры сделают восемь фотографий. Более того, гаджет сравнит эти снимки и соединит их, чтобы создать лучший вариант фото. В следующий раз, когда вы будете в восторге от результата, помните: это может быть вовсе не ваша заслуга.

2. ИИ меняет то, как мы храним и используем фотографии

ИИ призван делать наши жизни менее сложными. И действительно, хранить терабайты фотографий и быстро находить среди них нужные еще никогда не было так просто. Если вы поклонник Apple, то наверняка используете iCloud, алгоритм которого распознает лица и локации на фотографиях. Или, возможно, вы храните снимки на Google Photos, его ИИ-характеристики кардинально меняют срок жизни и функцию фотографии.

Хороший пример – Google Cloud Vision API, позволяющий надежно хранить изображения, просматривать и обрабатывать миллионы фотографий, а также определять метаданные: лица, ориентиры, почерк, текст и другие важные детали, которые системы управления обычно упускают.

Эта технология особенно полезна для фоторедакторов. Когда Google начал оцифровывать фотоархив The New York Times, содержащий от 5 до 7 миллионов файлов, он также создал инфраструктуру, которая обеспечивает немедленный доступ к архиву на рабочем столе. Эта технология позволяет не только отслеживать то, что происходит сейчас, но и видеть общую картину и погружаться в контекст того, что происходило раньше.

Сегодня сторителлинг – не просто концепция создания серии повествовательных изображений. Он помогает выяснять факты, события и восстанавливать по фрагменту историю, которая имеет значение для десятков миллионов людей. Фотографии, которые могли быть захоронены в архиве, теперь могут исполнять первоначальную функцию: передавать то, что видели другие.

3. ИИ влияет на процесс редактирования и постпродакшн

Еще одна сфера, на которую повлиял ИИ, – редактирование и постпродакшн. CEO в Skylum Software Алекс Цепко предполагает, что через пять или десять лет ИИ будет движущей силой фотографии. Фотографы смогут легко справляться с техническими задачами. Качество снимков, даже сделанных с помощью смартфона, будет намного выше.

Последнее уже стало возможным, когда Apple представил HEIF (High Efficiency Image File Format) для девайсов, обновленных до iOS 11 или более поздних версий. HEIF дает лучшее качество изображения, чем JPEG, а весят эти файлы в два раза меньше. Это позволяет хранить намного больше изображений на гаджетах и в iCloud Photos, не жертвуя качеством. К тому же на этапе обработки вы сможете внести больше изменений, чем с JPEG.

В то же время нет никакой необходимости тратить много усилий на редактирование и постпродакшн. С ИИ-технологией в Luminar 4 вы можете делать множество сложных правок, просто перемещая ползунок: улучшать тон лица, менять композицию, восстанавливать цвет и даже обрабатывать RAW-файлы.

Наступает момент, когда приложения для редактирования меняют реальность. Это в основном происходит из-за GAN (Generative Adversarial Network) – алгоритма машинного обучения, который улучшает и генерирует изображения. Например, Nvidia опубликовала доклад, в котором показано, как создать изображения невероятного качества с помощью обеих составляющих GAN – генератора и дискриминатора.

Они создали фейковые изображения знаменитостей, которые выглядят удивительно реалистичными. Для этого Nvidia провела целое исследование. Чтобы GAN генерировала картинки, технология должна обработать большое количество изображений. Кроме создание фейковых лиц, GAN может менять эмоции, возраст и выражение лица человека.

Проанализировав множество ИИ-технологий, можно прийти к выводу, что развитие этого направления одновременно впечатляет и настораживает. С одной стороны, API, как Google Cloud Vision, позволяет направить все наши усилия на то, чтобы сделать мир лучше. Например, нам не нужно днями сидеть в архивах, вручную перебирая фото, которые могут пригодиться в работе. Мы можем легко восстановить забытые истории, проанализировать их и поделиться с другими.

С другой стороны, мы сталкиваемся с технологиями, которые меняют идеи и функции вещей. Самое пугающее – то, что они могут искажать реальность. Помимо экспериментов Nvidia c фейковыми селебрити, мир уже захватили такие виртуальные инфлюенсеры, как Микаела.

В 2018 году Алекс Цепко заявил, что ИИ поможет фотографам стереть разницу между тем, что видят наши глаза, и тем, что фиксирует камера. Сегодня, накануне 2020 года, мы можем предположить, что со временем ИИ изменит и суть фотографии. Что вы думаете об этих новостях и последних достижениях в сфере ИИ? Поделитесь своими мыслями в комментариях.

Кто пустил ИИ в дом? «Умная» камера как предвестник апокалипсиса

С началом весны Google запустила продажи Google Clips. Это родоначальник нового класса устройств, именуемых «умными» камерами. Цена ему определена в 249 долларов. На вопрос, можно ли его приобрести, впрочем, отвечу: нет, ибо доступна новинка пока только в континентальных США. Но в данном случае намного важнее: а захотите ли? Потому что вопрос этот, при всей его простоте, скрывает такую страшную подноготную, что грех не изложить её подробно.

На случай, если вы не читали обзоров: Google Clips — портативная цифровая камера, размером буквально чуть больше крупной монеты. Конструкторы поставили во главу угла минимализм — и выдали интересное даже внешне устройство. Фиксированный широкоугольный объектив (задуманный для съёмки сцен на расстоянии от метра до нескольких), единственная кнопка с той же стороны, но ни видоискателя, ни дисплея с обратной. Камера привязана по Wi-Fi к смартфону хозяина, так что через специальное приложение ракурс перед съёмкой всё-таки оценить можно. Но изюминка в том, что человеку снимать и не предполагается: Google Clips сама определит наиболее удачный момент и нажмёт на «спуск»!

Всё, что требуется от пользователя, это подыскать удачное место, укрепить камеру (в том числе пристяжной клипсой, откуда, вероятно, и название) и не забыть забрать её после того, как действие, которое планировалось отснять (вечеринка, отдых с ребёнком, кормёжка питомца — что угодно с участием вас и ваших близких людей и/или зверей), завершится.

Как печально заметил Элон Маск, комментируя выпуск Google Clips и выражая главное общее опасение, с ней связанное, «эту штуку даже не пытались замаскировать под безобидную». Но на самом деле главная угроза вовсе не в возможном ущербе для приватности…

Как печально заметил Элон Маск, комментируя выпуск Google Clips и выражая главное общее опасение, с ней связанное, «эту штуку даже не пытались замаскировать под безобидную». Но на самом деле главная угроза вовсе не в возможном ущербе для приватности…

Результат работы Google Clips — некоторое количество коротких (обычно 7 секунд) роликов, из которых впоследствии, уже на телефоне или компьютере, можно вырезать удачные кадры, либо сохранить ролики целиком в форме анимаций. Таким образом, вооружившись ею, вы наконец тоже сможете присутствовать в кадре и переживать приятные моменты с дорогими вам людьми, а не торчать «по ту сторону» объектива, нервничая, как бы чего не пропустить. Плюс, не придётся продираться сквозь сотни однотипных снимков после: кадров-кандидатов, которые камера предложит вам на рассмотрение, предположительно должно получаться немного — потому что Google Clips не снимает всё подряд, а именно выбирает самое интересное.

Как она это делает? С помощью искусственного интеллекта. Google Clips — это самодостаточный (интернет не требуется) самообучающийся программно-аппаратный комплекс, оптимизированный для распознавания людей и домашних животных. Хозяина он знает в лицо — как и всех тех, кто появляется с хозяином: чем чаще те или иные лица будут рядом с ним мелькать, тем чаще их станут фотографировать. Процесс обучения можно подстегнуть или направить в нужном направлении, предоставив камере доступ к персональной коллекции фотографий Google Photos, а также время от времени нажимая «спуск» собственноручно.

Однако помимо распознавания лиц Google Clips натренирована и самостоятельно определять потенциально наиболее удачные, то есть запоминающиеся, кадры. Этому её учила группа профессиональных фотографов ещё на этапе проектирования: что забраковать сразу (рука в кадре, расфокус и т.п.), что предпочесть (лицо крупным планом против лица с краю, например, или значительное число знакомых лиц в толпе, или высоко ценимые человеческим глазом эстетические свойства, вроде широкой палитры). В результате она не только избавляет человека от необходимости караулить «у окуляра», но и предположительно способна поймать больше искренних, не постановочных сцен. Без этого у Google получилась бы просто очередная экшн-камера, которых и так уже полно — от пресловутой GoPro до экзотической PetCube (специально для слежки за братьями меньшими).

Примерно так снимает Google Clips

Примерно так снимает Google Clips

Важно, что всё отснятое остаётся исключительно в памяти камеры или привязанного к ней смартфона — по крайней мере до тех пор, пока поделиться этим не решит сам хозяин. Так устраняется главное опасение, связанное с (почти) постоянно включенным цифровым оком: вторжение в личную жизнь. Этим же ограничиваются и 99% обзоров Google Clips. Тон их, поначалу неумеренно восторженный, после начала продаж, кстати, подувял: как и следовало ожидать, качество снимков (во всех смыслах) оказалось невысоким — ИИ ловит слишком много всего и хуже ожидаемого угадывает запоминающиеся моменты.

Однако вовсе не возможная утечка снимков в чужие руки — самая страшная угроза, которую таит «умная» камера. Важно понимать, что «в лице» Google Clips искусственный интеллект, до сих пор ограничивавшийся осторожными пробными подходами, начал полномасштабное вторжение в быт.

Зачем нам ИИ в быту, почему мы не можем обойтись простыми автоматами? А потому и для того, что человек мечтает разгрузить себя от рутинных операций. И везде, где операции эти не ограничены чисто механическим повторением, требуется машина, обладающая интеллектом, способная принимать решения за нас. Четыре года назад скандал (среди людей понимающих) вызвала написанная всё той же Google функция «фотографического автокреатива»: ИИ научили «улучшать» фотографии — вплоть до компоновки событий, которых на самом деле не происходило (вспомните: «ИИ «улучшает» историю»). Уже тогда «неосторожное» поведение машины способно было навредить человеку — бросив тень подозрения на индивида, якобы оказавшегося в выдуманной ситуации. Сегодня Google Clips переводит проблему на следующий уровень.

Устройства с встроенным ИИ вводят новый термин: VPU — vision processing unit, процессор машинного зрения. Это чип, предназначенный для аппаратного ускорения работы алгоритмов машинного зрения. Google Clips использует нейросетевой Movidius Myriad 2 от Intel. Он же, кстати, стоит и в дронах DJI.

Устройства с встроенным ИИ вводят новый термин: VPU — vision processing unit, процессор машинного зрения. Это чип, предназначенный для аппаратного ускорения работы алгоритмов машинного зрения. Google Clips использует нейросетевой Movidius Myriad 2 от Intel. Он же, кстати, стоит и в дронах DJI.

Чем на самом деле опасна камера, самостоятельно решающая, когда нажимать на «спуск»? Вовсе не тем, что личные фотографии утекут в АНБ, будут проданы рекламным партнёрам Google или украдены злобными хакерами. Нет, всё это действительно может случиться, но всё это меркнет на фоне новой угрозы. Давайте сформулируем в абстрактных характеристиках: впервые в человеческой истории наша документальная память начинает наполняться документами, созданными не нами самими.

Вообразите фотоальбом, обычный семейный фотоальбом, хранящий фотографическую летопись отдельно взятой ячейки общества. До сих пор фотографии для него делались только людьми. Родители, например, сами решали, что в какой-то момент в какой-то ситуации следует запечатлеть ребёнка — так что если двадцать лет спустя он спросит, почему то или иное фото было сделано, они в состоянии сформулировать причину. Необыкновенная улыбка, двухколёсный велосипед как первое большое достижение, первый осмысленный контакт с противоположным полом… Но с Google Clips всё иначе.

Ценность момента, удачность фотографии определяются здесь не субъективным ощущением, присущим зачастую лишь близким людям, а набором чётко сформулированных логических критериев. И когда те же двадцать лет спустя, недоумённо взирая на странный снимок из альбома, отснятого «умной» камерой, ребёнок спросит «Почему?», родителям будет нечего ответить, кроме «Так решила машина!».

А как именно она решила? Да суммировав параметры, которые можно объективно измерить и постановив, что, поскольку сумма больше значения X, данный момент достоин запечатления! Скажем, относительное число улыбающихся лиц к общему числу лиц, присутствующих в кадре, плюс белизна улыбки объекта А-02 к среднестатистической, плюс степень приближения позы домашнего животного Б-1 к ранее натренированному множеству «Няшный котик».

И если вас сейчас не пробрало, если волосы не шевелятся на голове от страха, вы просто не включили воображение. Потому что с тем же энтузиазмом, с которым машина «щёлкнет» гугукающего младенца на руках у хозяина, она, уж простите за резкость сравнения, «щёлкнет» и самого хозяина, если он, например, решит удавиться перед объективом. Оценит величину его выкаченных глаз, необыкновенность цвета вывалившегося языка, близость позы извивающегося в агонии тела к какому-нибудь подмножеству «Юмористическое селфи», и — щёлкнет. Готов даже поспорить, случится это в следующие год или два — и будет случаться с той же регулярностью, с которой нынче вышибают себе мозги перед камерой в фейсбуках.

Вот так, сквозь набор заученных атрибутов, искусственные нейросети «видят» мир (здесь: пример из арсенала Amazon Rekognition)

Вот так, сквозь набор заученных атрибутов, искусственные нейросети «видят» мир (здесь: пример из арсенала Amazon Rekognition)

Ограниченность ИИ, непонимание им контекста — огромная проблема, имеющая множество проявлений: от невозможности гарантированно фильтровать спам до неспособности уверенно выявлять порнографию. Связанная с этим дискуссия тянется уже десятилетия: обыватели, бизнесмены, политики любят время от времени наступить на старые грабли — любят забыть, что вычислительные машины не только не всемогущи, а и очень ограничены в возможностях. Но до сих пор ИИ работал только с ведома человека, по нашему приказу. Google Clips, повторюсь, проводит черту: отныне ИИ начал массово работать параллельно с нами и над задачами, которые непосредственно влияют на наше понимание самих себя.

Происходящее сейчас хорошо вписывается в картину проникновения ИИ в быт, которую любят рисовать его, искусственного интеллекта, сторонники. На мой вкус лучше многих это сформулировал текущий главный юрист Microsoft и её же президент Брэдфорд Смит. Вспомните, предлагает он, как начинался обычный день двадцать лет назад. Скорее всего тогда вы вообще не имели дела с цифровыми устройствами: выключали аналоговый будильник, включали аналоговый телевизор, перелистывали бумажный календарь. И предположить, что однажды всё это будет чем-то заменено, да ещё и чем-то одним, вместо целой кучи вещей и устройств, было… ну, как минимум, смело.

Однако же это произошло и сегодня вы начинаете день со смартфона или компьютера — то есть цифрового устройства, вобравшего все важные функции. Что будет через 20 лет? Произойдёт ещё одна большая замена: день будет начинаться с общения с ИИ-помощником! ИИ сделает пользование теми же функциями ещё проще: он сам решит, какая информация для нас важнее в конкретной ситуации, сам решит, в какой форме её наиболее удобно подать…

Впрочем у нас как будто бы всё ещё есть выбор. Мы ведь можем и не захотеть иметь рядом с собой такого помощника — бездушного, ограниченного, но прячущегося под маской человека, делающего вид, что понимает нас, что разделяет наши ценности. Так захотим ли? Что ж, рынок ответ уже дал. В магазине Google аншлаг, первая партия Google Clips распродана без остатка.